مع التطورات التي تشهدها تقنيات الذكاء الاصطناعي، أصبح التمييز بين صورة تم التقاطها بشكل طبيعي وأخرى تم توليدها باستخدام الذكاء الاصطناعي، أمرًا صعبًا، في ظل الواقعية الكبيرة التي تتمتع بها الأخيرة.

وتُمكّن بعض البرامج المدعومة بالذكاء الاصطناعي مثل "دل إي تو DALL-E 2 " و"ميدجورني Midjourney" من توليد صور قريبة جدًا من الواقع، وفي حين أن البعض يستخدم هذه التقنيات لإنشاء صور على سبيل المزاح، يحاول آخرون استخدامها في أغراض أخرى قد تتعلق بالسياسة.

وعلى الرغم من أنه عادة ما يتم الإشارة إلى الطريقة التي تم بها توليد هذه الصور، إلا أنها مع المشاركة الواسعة لها عبر مواقع التواصل الاجتماعي، تضيع هذه المعلومات ويبدأ البعض في التصديق بأنها حقيقية.

ومؤخرًا، انتشرت مجموعة من هذه الصور، كان منها واحدة يظهر فيها الرئيس الروسي فلاديمير بوتين وهو يركع ويقبل يد الرئيس الصيني شي جينبينغ، وأخرى تتعلق بالرئيس الفرنسي إيمانويل ماكرون، وهو يجمع النفايات.

L'#ia #photo a fait des progrès démentiels en très peu de temps, désormais le #fake sera la norme sur les #reseaux, doutez de ce que vous voyez par défaut, plus le choix.#midjourney #midjourneyv5 pic.twitter.com/dJoZXGrbRy

— Cryptonoo₿ From 100K to 0 🐐 (@Cryptonoobzzzz) March 19, 2023

ولكن في ظل ذلك، هناك عدة طُرق يمكن من خلالها اكتشاف حقيقة الصور ومنها:

العنوان والوصف والتعليقات

ربما لا يذكر بعض مصممي الصور أنها وليدة الذكاء الاصطناعي، ولكن حال ذكر ذلك سيكون من السهل عليك أن تتحقق من هذه المعلومات في قسم الوصف في المنشور، أو حتى في التعليقات التي تتضمن في الكثير من الأحيان معلومات إضافية.

العلامة المائية

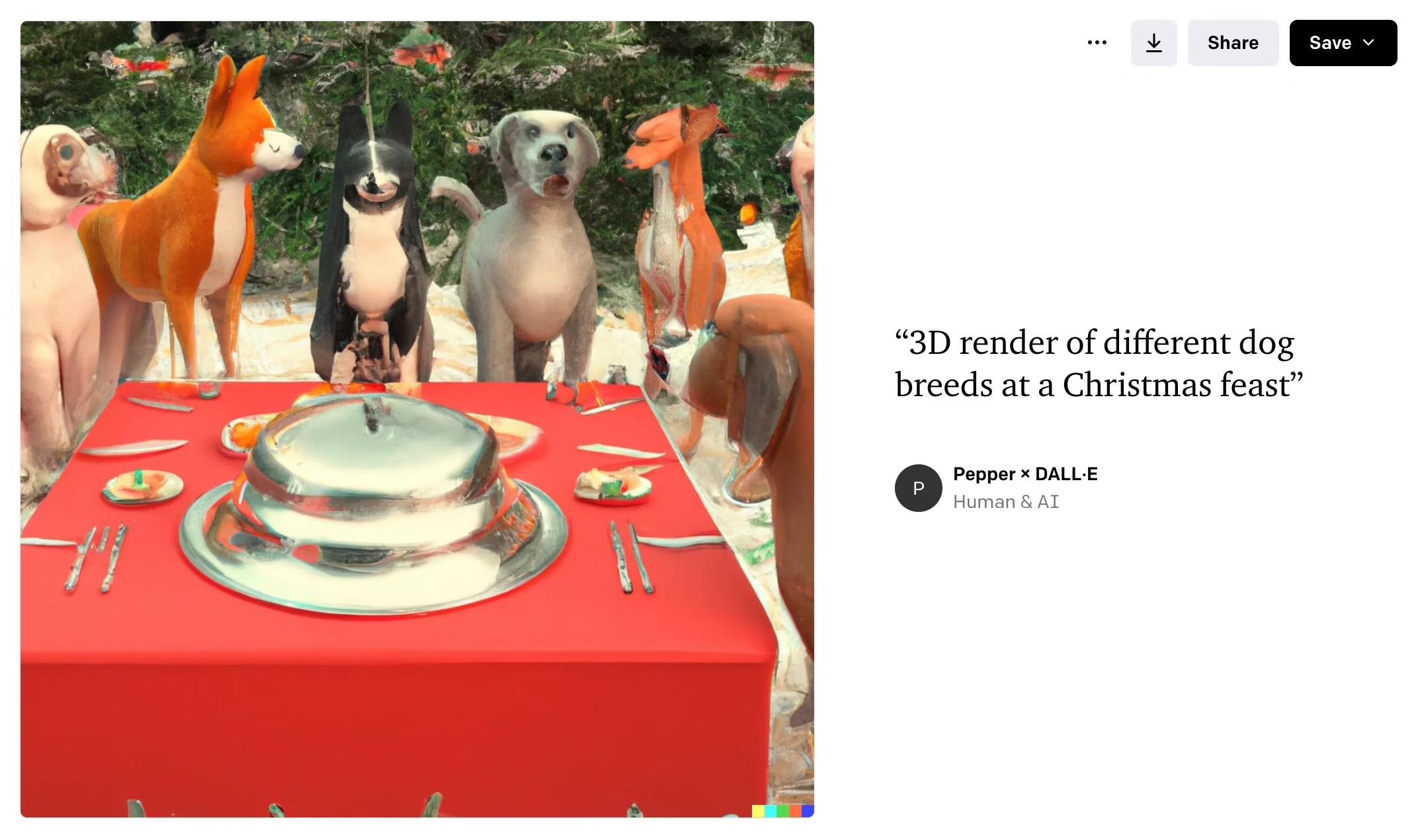

تعتبر العلامة المائية دليلاً آخر مهمًا لتحديد الصورة التي تم إنشاؤها بواسطة الذكاء الاصطناعي، وعلى الرغم من أنها قد تكون غير واضحة في البداية، إلا أنه بالتركيز ستعثر عليها، مثل العلامة المائية الخاصة ببرنامج "دال إي تو" التي تتكون من 5 مربعات ملونة كما في الصورة أدناه.

التركيز في التفاصيل

قد لا تلاحظ ذلك في البداية، ولكن غالبًا ما تشترك الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي في بعض العلامات الغريبة أو التشوهات التي تكون أكثر وضوحًا عند إلقاء نظرة فاحصة.

في الصورة التالية، تظهر عدة كلاب جالسة حول مائدة العشاء، ولكن عند الفحص الدقيق تدرك أن بعض عيون الكلب مفقودة، وأن الوجوه الأخرى تبدو ببساطة وكأنها لطخة من الطلاء.

استخدام كاشف GAN

هي أداة تم إنشاؤها في عام 2021، على أمل حل مشكلة تحديد الصور التي تم إنشاؤها بواسطة الذكاء الاصطناعي، ولكن نتائج الأداة قد تكون غير دقيقة في بعض الأحيان، لذا يُنصح باستخدامها مع طرق أخرى لاختبار ما إذا كانت الصورة حقيقة أم تم توليدها بواسطة الذكاء الاصطناعي.

مصدر الصورة

من ناحية أخرى، يعتبر متخصصون في الذكاء الاصطناعي أن نتائج هذه الأدوات قد تكون غير دقيقة، إذ تعتمد تقنيات الذكاء الاصطناعي على قاعدة بيانات تتكون من مجموعة صور، يقوم بتفكيكها إلى أجزاء عديدة ومن ثم إعادة استخدامها في صنع صور جديدة تمامًا يكون من الصعب تتبع تفاصيلها.

كما يعتقد الخبراء، وفق ما نقلته عنهم فرانس برس، أن الاعتماد على البيانات الوصفية الخاصة بالصورة في التأكد من حقيقتها تُعتبر غير مجدية، إذ إن هذه المعلومات يتم حذفها بمجرد تحميلها على مواقع التواصل.

وينصح المتخصصون بضرورة العودة إلى مصدر الصورة من خلال حساب ناشرها الأصلي والتي ربما يذكر فيه تفاصيل عن الطريقة التي صُنعت بها، أو من خلال البحث العكسي عنها في محركات البحث للعثور على الصفحات التي نشرتها.

وساعدت هذه الطريقة في اكتشاف حقيقة الصورة المنسوبة إلى الرئيس الأمريكي السابق دونالد ترامب، والتي يظهر فيها وهو يتعرض للتوقيف من قبل الشرطة.

Making pictures of Trump getting arrested while waiting for Trump's arrest. pic.twitter.com/4D2QQfUpLZ

— Eliot Higgins (@EliotHiggins) March 20, 2023

وأظهر البحث أن الصورة تعود إلى تغريدة نشرها مؤسس موقع بيلينغات المتخصّص بالتحقيقات المفتوحة المصدر، إليوت هيغينز، والتي أكد فيها أن الصورة مصنوعة بواسطة تقنيات الذكاء الاصطناعي.

التدقيق في خلفية الصور

عادة ما ينصب التركيز عند رؤية الصور على الأهداف القريبة أو الواضحة، ولكن قد تحمل الخلفية الكثير خصوصًا في تلك الصور المصنوعة بواسطة الذكاء الاصطناعي.

ففي الصورة الخاصة بالرئيس بوتين ونظيره الصيني، تظهر خلفية الصالة مختلفة عن تلك التي اجتمع فيها الرئيسان في الواقع، كما أن الصورة التالية التي يظهر فيها الرئيس الأميركي باراك أوباما والمستشارة الألمانية السابقة أنجيلا ميركل على شاطئ، تضم الكثير من التشوهات، مثل أرجل الشخص المقطوعة في الخلفية.

بشكل عام، فإن التطورات الحالية في الذكاء الاصطناعي في إنشاء الصور، تتطلب البحث والتدقيق بأي طريقة، عند الشك في حقيقة أي صورة وخصوصًا تلك المتعلقة بأحداث سياسية أو عنف.

خبراء الذكاء الاصطناعي في شركات التقنية

أكثر الشعوب ثقة في الذكاء الاصطناعي

فيديو| هل يمكن أن يدمر الذكاء الاصطناعي البشرية؟.. مهندس سامي الحلوة يجيب